L’application vérifiée Olostep sur Zapier vous offre cinq actions à l’intérieur du constructeur visuel de Zapier : extraire une URL, obtenir des réponses IA, extraire par lots des milliers d’URLs, crawler un site ou cartographier tous ses liens, puis connecter les résultats à n’importe laquelle des 8 000+ applications. Voir sur Zapier →Documentation Index

Fetch the complete documentation index at: https://docs.olostep.com/llms.txt

Use this file to discover all available pages before exploring further.

Avant de commencer

- Un compte Olostep avec une clé API : obtenez-en une gratuitement, aucune carte de crédit requise. Vos premiers 500 crédits sont inclus.

- Un compte Zapier : n’importe quel plan fonctionne. Les plans gratuits peuvent exécuter des Zaps manuellement ; les plans payants prennent en charge les Zaps programmés et multi-étapes.

- Aucune programmation requise : tout dans ce guide est réalisé via l’éditeur visuel de Zapier.

Configuration

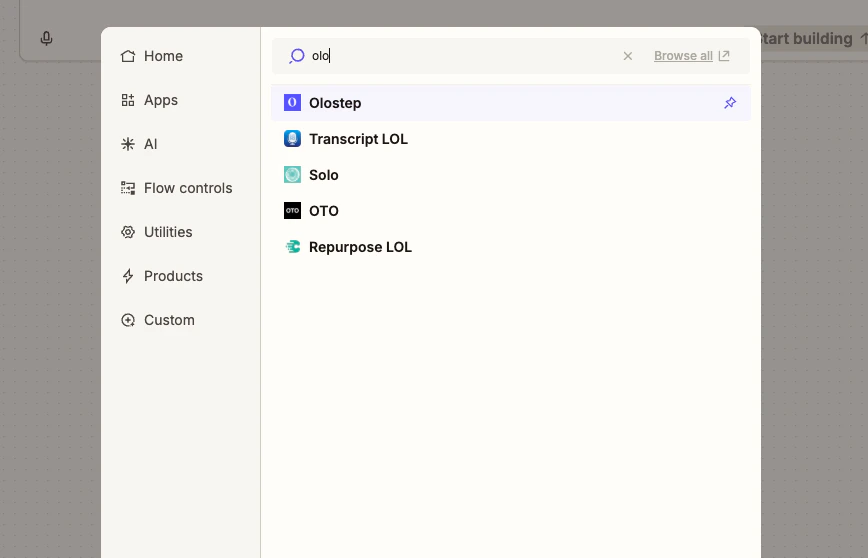

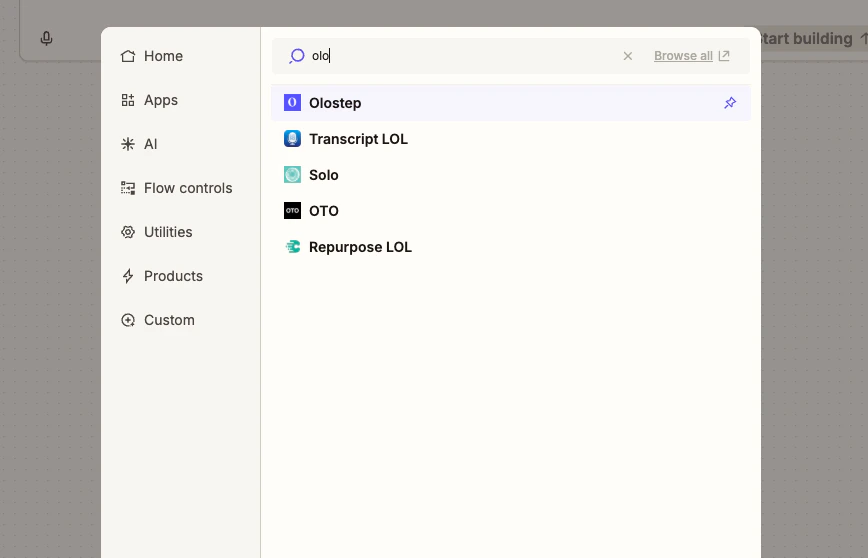

Trouver Olostep dans Zapier

Ouvrez n’importe quel Zap, cliquez sur + pour ajouter une action, et recherchez Olostep. Sélectionnez Olostep dans les résultats.

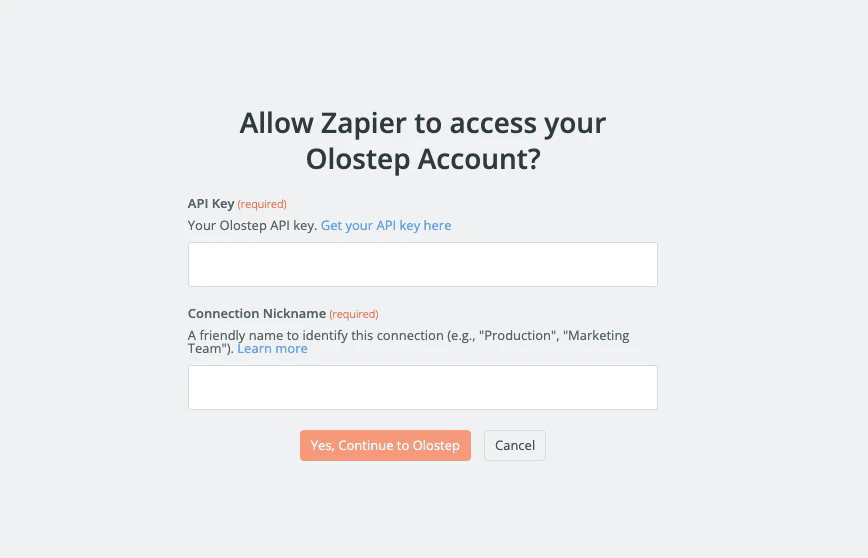

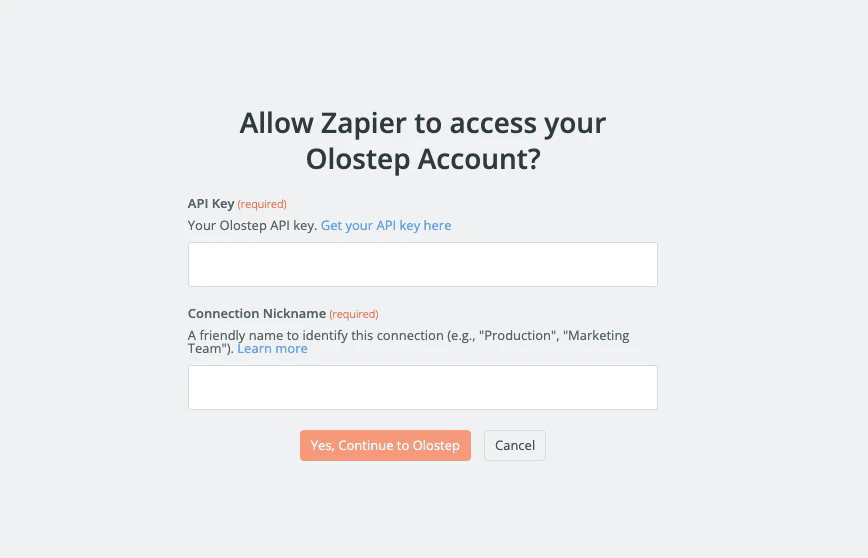

Connectez votre compte

Cliquez sur Se connecter à Olostep. Collez votre clé API dans le champ et cliquez sur Oui, continuer vers Olostep. Zapier vérifiera la clé et enregistrera l’identifiant pour tous les futurs Zaps.

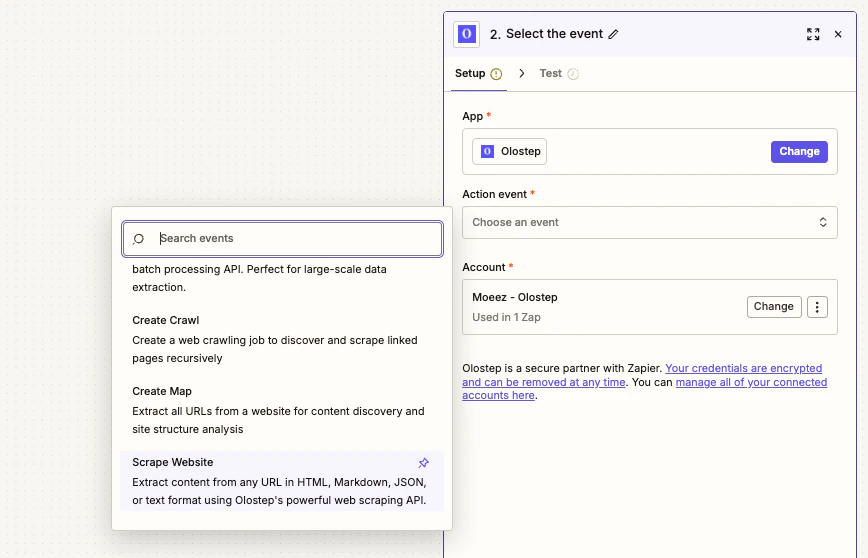

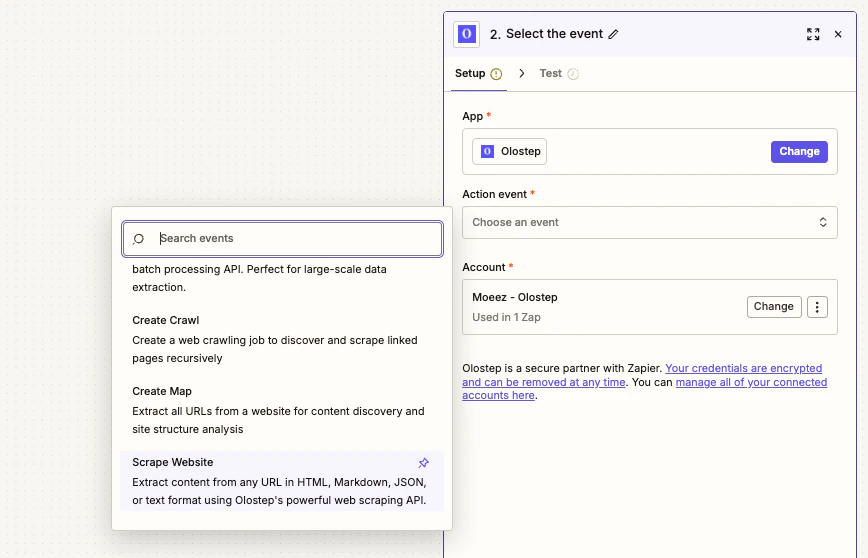

Choisissez une action

Avec votre compte connecté, choisissez l’une des cinq actions Olostep dans le menu déroulant Action et remplissez les champs requis.

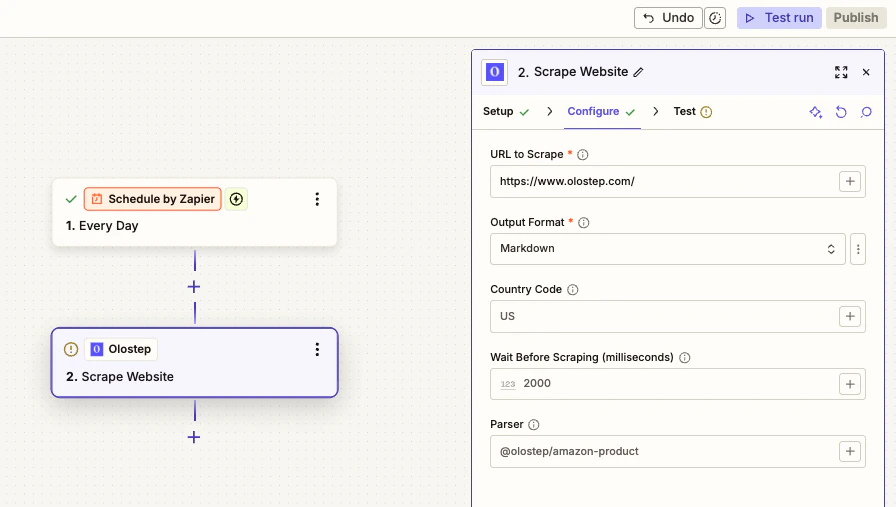

Configurer Scrape Website (URL + format)

- URL à extraire : mappez-la à partir de votre déclencheur ou entrez-la manuellement

-

Format de sortie : choisissez

Markdown,HTML,JSONouTexte

Actions

Scrape Website

Extraire le contenu de n’importe quelle URL sous forme de Markdown, HTML, JSON ou texte brut. Gère les pages rendues en JS avec des temps d’attente optionnels et un ciblage par pays.

Ask AI Answer

Posez une question en langage naturel et obtenez une réponse citée basée sur les pages que vous fournissez ou une recherche web en direct.

Batch Scrape URLs

Soumettez jusqu’à 100 000 URLs en un seul travail, traitées en parallèle. Retourne un

batch_id; récupérez les résultats de manière asynchrone.Create Crawl

Commencez à partir d’une URL, suivez les liens et extrayez toutes les sous-pages. Idéal pour les sites de documentation, les blogs ou l’ingestion complète de sites. Retourne un

crawl_id.Create Map

Obtenez chaque URL sur un site sans extraire le contenu. Utilisez-le pour la découverte avant un travail par lots. Retourne un

map_id.Batch, Crawl, et Map sont asynchrones. Stockez l’ID retourné et utilisez une étape de Délai ou un second Zap pour récupérer les résultats une fois le traitement terminé.

Exemple de flux de travail : Briefing quotidien sur les concurrents

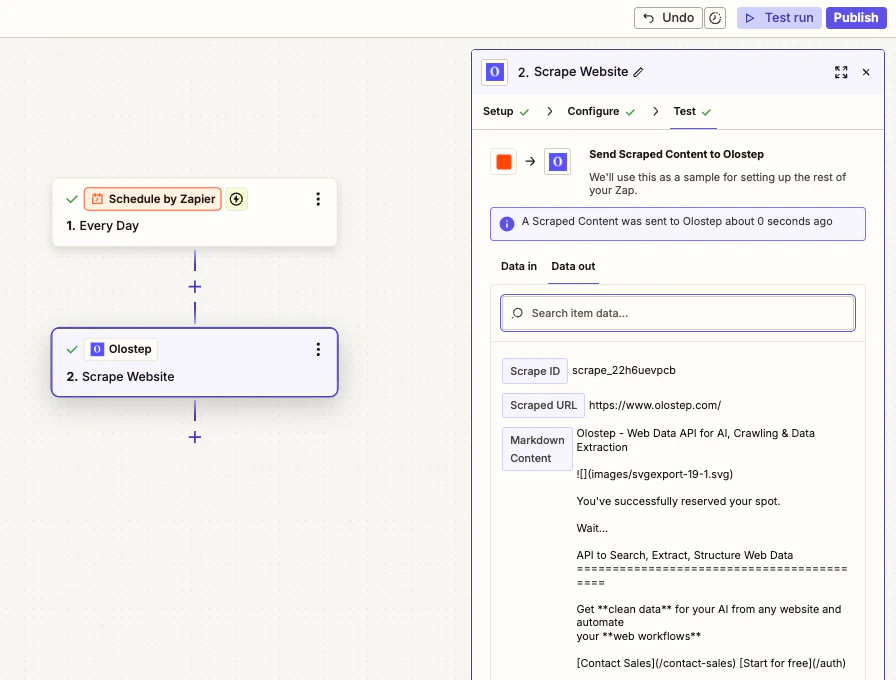

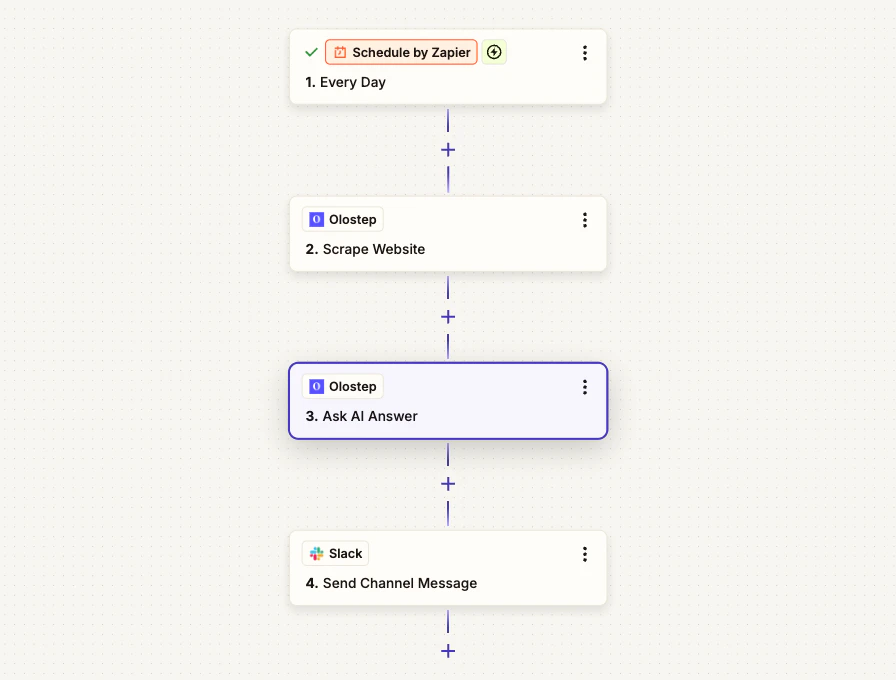

Ce qu’il fait : Chaque matin, ce Zap extrait une page concurrente, demande à Olostep AI Answer de résumer les principales mises à jour de cette page, et publie le briefing final avec citations sur Slack. Nœuds utilisés : Schedule by Zapier -> Olostep Scrape Website -> Olostep Ask AI Answer -> Slack

Étape 1 : Ajouter un déclencheur Schedule

Dans Zapier, créez un nouveau Zap et définissez le déclencheur sur Schedule by Zapier. Réglez-le pour s’exécuter Tous les jours à une heure qui convient à votre équipe (par exemple, 8h).Étape 2 : Ajouter Olostep Scrape Website

Ajoutez une action Olostep et choisissez Scrape Website. Réglez :- URL :

https://competitor.com/blog - Format de sortie : Markdown

Étape 3 : Ajouter Olostep Ask AI Answer

Ajoutez une deuxième action Olostep et choisissez Ask AI Answer. Réglez :- Question :

Quelles sont les principales mises à jour, annonces, changements de produit ou changements de prix sur cette page aujourd'hui ? Retournez un briefing concis avec des puces et incluez des citations. - URLs de contexte (tableau JSON) : mappez l’URL extraite de l’étape 2

- Format : Markdown

- Inclure les citations : vrai

Étape 4 : Envoyer à Slack

Ajoutez une action Slack réglée sur Envoyer un message de canal. Mappez :- Canal :

#competitive-intel - Texte du message :

Briefing quotidien sur les concurrents - Corps du message :

{{Answer (Markdown)}}

Ce que vous obtenez

Chaque matin, votre canal Slack reçoit un message comme :Briefing quotidien sur les concurrentsÀ partir de là, vous pouvez étendre ce Zap : ajoutez un Filtre pour ne publier que si des mots-clés spécifiques apparaissent, écrivez des briefings dans Google Sheets pour le suivi, ou exécutez des Zaps séparés pour différentes URLs de concurrents.Sources : competitor.com/blog, competitor.com/pricing

- Lancement d’une nouvelle intégration pour les flux de travail ecommerce

- Mise à jour de la page de tarification avec un nouveau plan intermédiaire

- Publication de deux nouveaux articles de blog sur les meilleures pratiques en matière d’automatisation

Parseurs

Ajoutez un ID de parseur au champ Parser sur n’importe quelle action Scrape ou Batch pour obtenir des données structurées au lieu de contenu brut :| Parseur | Extraits |

|---|---|

@olostep/amazon-product | Titre, prix, évaluation, avis, images, variantes |

@olostep/google-search | Titres des résultats, URLs, extraits |

@olostep/google-maps | Nom de l’entreprise, adresse, évaluation, avis |

@olostep/extract-emails | Adresses email de n’importe quelle page |

@olostep/extract-socials | Liens de profils sociaux (X, GitHub, LinkedIn, etc.) |

@olostep/extract-calendars | Liens Google Calendar et ICS |

Limitations de Zapier & Solutions

Limites de tâches

Zapier compte chaque action comme une tâche contre la limite de votre plan. Solution : Utilisez Batch Scrape URLs pour traiter plusieurs URLs comme une seule tâche au lieu de boucler une action d’extraction unique.Délai d’exécution

Les Zaps expirent après 30 secondes. Les crawls et les grands travaux par lots prennent plus de temps. Solution : Stockez l’crawl_id ou batch_id retourné et récupérez les résultats dans un Zap séparé déclenché par un webhook ou un délai programmé.

Limites de taille de données

Zapier limite la taille des données pouvant passer entre les étapes, ce qui peut poser problème avec de grandes charges d’extraction. Solution : Utilisez les URLs de sortie hébergées retournées par Olostep pour récupérer le contenu volumineux séparément plutôt que de passer le contenu brut entre les étapes.Déclencheurs de sondage

La plupart des déclencheurs Zapier sondent à un intervalle de 5 à 15 minutes, pas instantanément. Solution : Utilisez le déclencheur Webhooks de Zapier pour une notification instantanée, ou programmez les Zaps à des heures fixes plutôt que de compter sur un sondage quasi en temps réel.Dépannage

Clé API rejetée

Clé API rejetée

Copiez la clé directement depuis olostep.com/dashboard sans espaces de fin. Déconnectez et reconnectez le compte Olostep dans Zapier si l’erreur persiste.

Contenu extrait vide

Contenu extrait vide

Augmentez Attendre avant d’extraire (essayez 2000–5000ms pour les pages lourdes en JS). Confirmez que l’URL est publiquement accessible sans connexion. Si un domaine spécifique échoue systématiquement, contactez info@olostep.com.

Erreur de format d'URL par lots

Erreur de format d'URL par lots

Le champ URLs à extraire attend un tableau JSON :Utilisez une étape Code by Zapier en amont pour construire ce tableau à partir de vos données si nécessaire.

Limite de taux atteinte

Limite de taux atteinte

Ajoutez une étape Délai entre les actions d’extraction, ou passez à Batch Scrape URLs au lieu de boucler des extractions uniques. Vérifiez l’utilisation actuelle dans le tableau de bord.

Le Zap expire sur un crawl ou un lot

Le Zap expire sur un crawl ou un lot

Ces opérations sont asynchrones par conception. Stockez l’ID retourné immédiatement après l’action, puis utilisez un second Zap ou un sondage programmé pour récupérer les résultats plus tard.

Connexes

Scrapes API

Référence complète pour le point de terminaison d’extraction

Batches API

Comment fonctionnent les travaux par lots et comment récupérer les résultats

Crawls API

Configuration des crawls et récupération des résultats

Maps API

Découverte d’URL et options de filtrage

Site Web Zapier

Plateforme Zapier