Die verifizierte Olostep-App auf Zapier bietet dir fünf Aktionen im visuellen Builder von Zapier: eine URL scrapen, KI-Antworten erhalten, tausende URLs im Batch scrapen, eine Seite crawlen oder alle ihre Links kartieren und die Ergebnisse dann mit über 8.000 Apps verbinden. Auf Zapier ansehen →Documentation Index

Fetch the complete documentation index at: https://docs.olostep.com/llms.txt

Use this file to discover all available pages before exploring further.

Bevor du beginnst

- Ein Olostep-Konto mit einem API-Schlüssel: kostenlos erhalten, keine Kreditkarte erforderlich. Deine ersten 500 Credits sind inklusive.

- Ein Zapier-Konto: Jeder Plan funktioniert. Kostenlose Pläne können Zaps manuell ausführen; bezahlte Pläne unterstützen geplante und mehrstufige Zaps.

- Kein Coding erforderlich: Alles in diesem Leitfaden wird über den visuellen Editor von Zapier erledigt.

Einrichtung

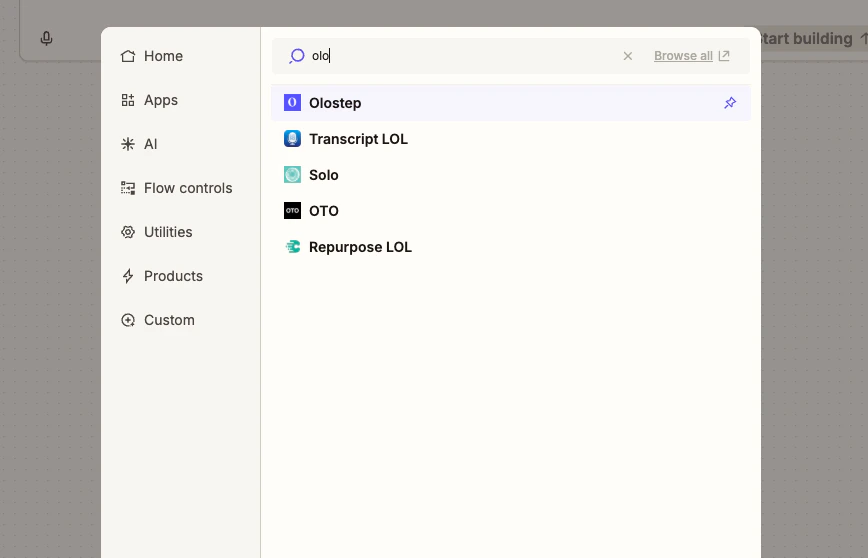

Finde Olostep in Zapier

Öffne einen beliebigen Zap, klicke auf +, um eine Aktion hinzuzufügen, und suche nach Olostep. Wähle Olostep aus den Ergebnissen aus.

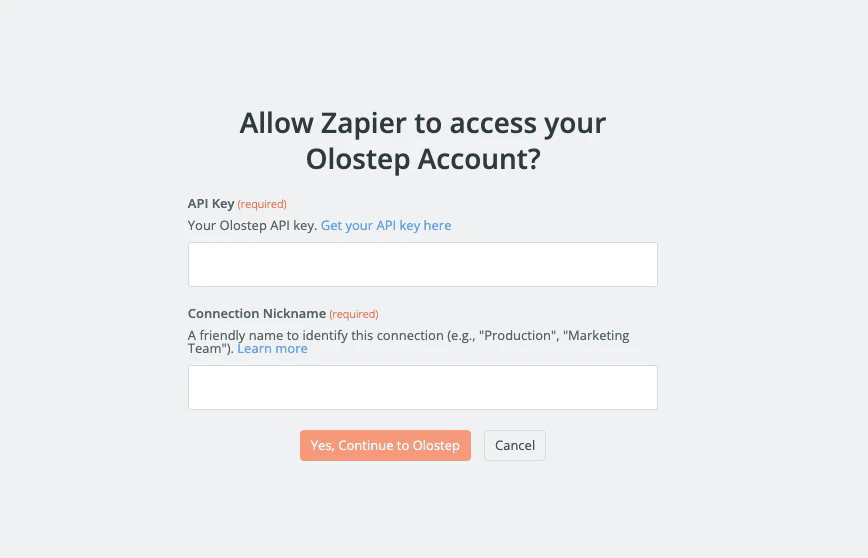

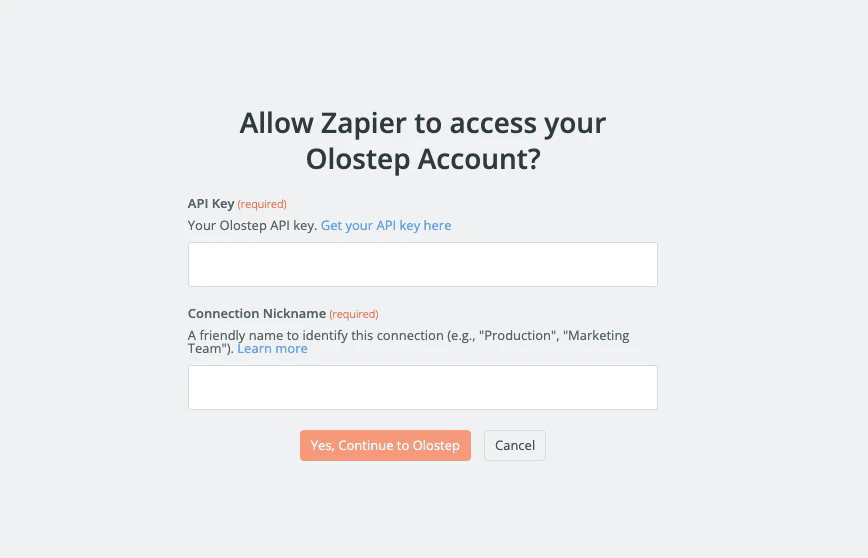

Verbinde dein Konto

Klicke auf Bei Olostep anmelden. Füge deinen API-Schlüssel in das Feld ein und klicke auf Ja, weiter zu Olostep. Zapier wird den Schlüssel verifizieren und die Anmeldedaten für alle zukünftigen Zaps speichern.

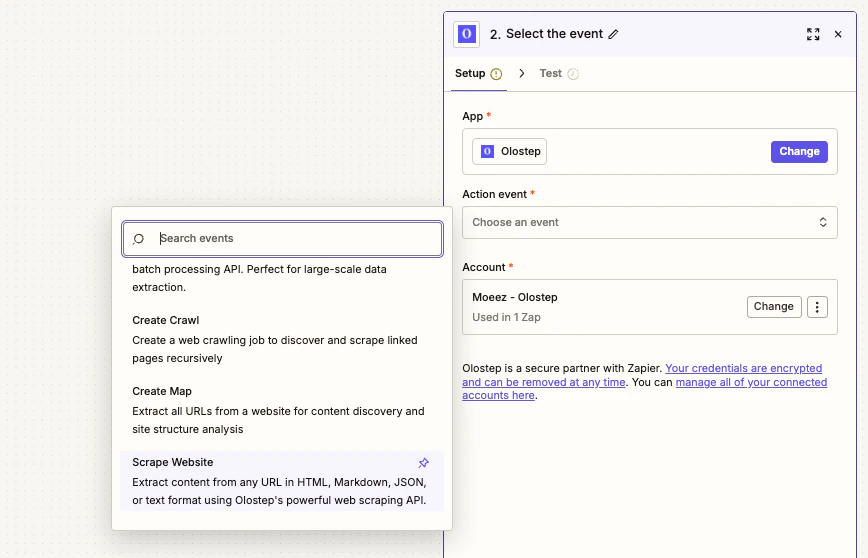

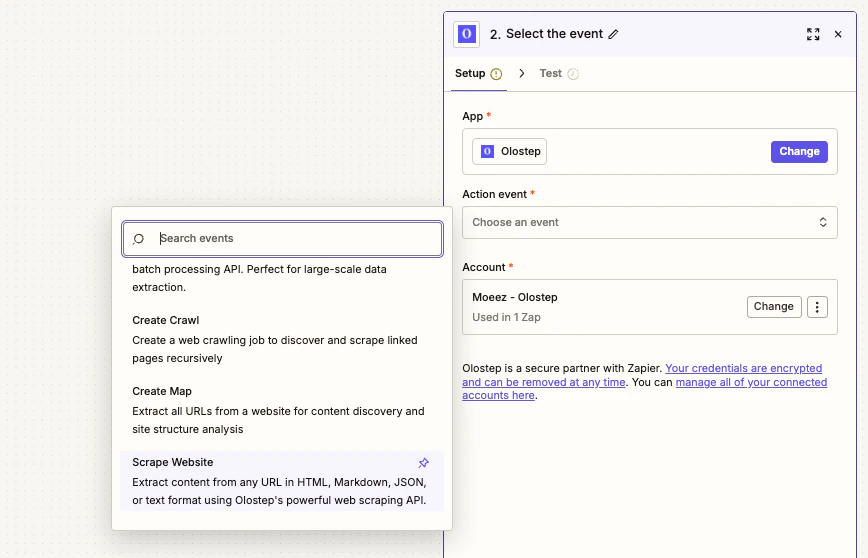

Wähle eine Aktion

Mit deinem verbundenen Konto wähle eine der fünf Olostep-Aktionen aus dem Aktion-Dropdown und fülle die erforderlichen Felder aus.

Konfiguriere Scrape Website (URL + Format)

- URL zum Scrapen: Mappe sie von deinem Trigger oder gib sie manuell ein

-

Ausgabeformat: Wähle

Markdown,HTML,JSONoderText

Aktionen

Scrape Website

Ziehe Inhalte von jeder URL als Markdown, HTML, JSON oder Klartext. Handhabt JS-gerenderte Seiten mit optionalen Wartezeiten und Länderziel.

Ask AI Answer

Stelle eine Frage in natürlicher Sprache und erhalte eine zitierte Antwort, basierend auf den von dir bereitgestellten Seiten oder einer Live-Websuche.

Batch Scrape URLs

Reiche bis zu 100.000 URLs in einem Job ein, die parallel verarbeitet werden. Gibt eine

batch_id zurück; Ergebnisse asynchron abrufen.Create Crawl

Beginne von einer URL, folge Links und scrape alle Unterseiten. Gut für Dokumentationsseiten, Blogs oder vollständige Seitenaufnahme. Gibt eine

crawl_id zurück.Create Map

Erhalte jede URL auf einer Seite ohne Inhalte zu scrapen. Verwende es zur Entdeckung vor einem Batch-Job. Gibt eine

map_id zurück.Batch, Crawl und Map sind asynchron. Speichere die zurückgegebene ID und verwende einen Verzögerungsschritt oder einen zweiten Zap, um Ergebnisse abzurufen, sobald die Verarbeitung abgeschlossen ist.

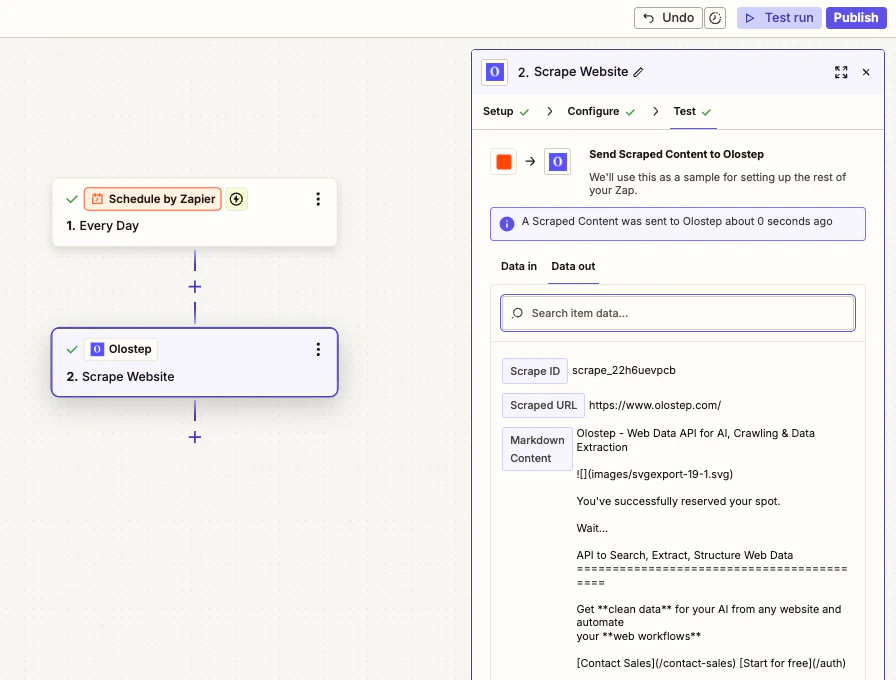

Beispiel-Workflow: Tägliches Wettbewerber-Briefing

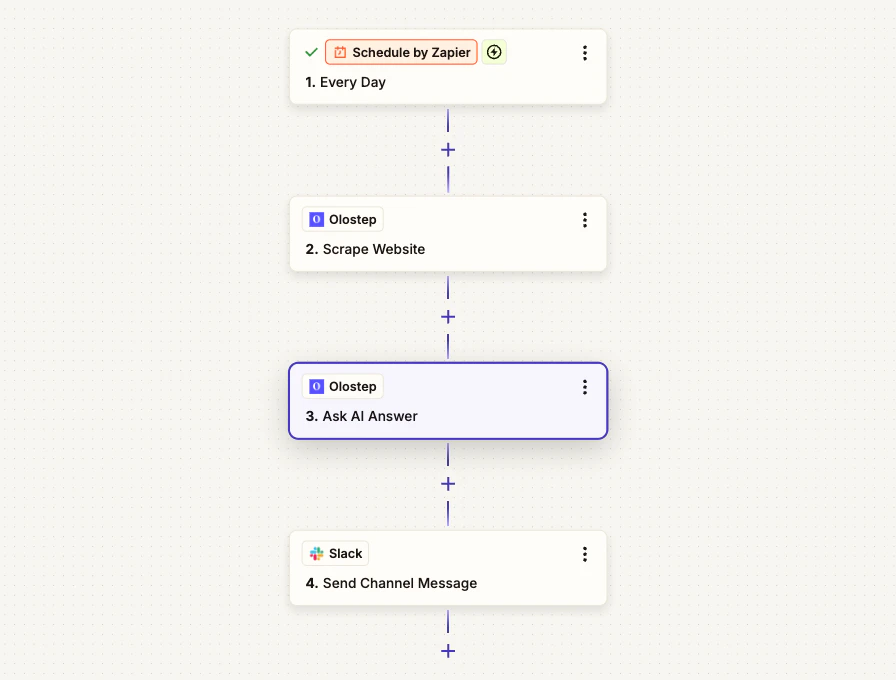

Was es tut: Jeden Morgen scrapt dieser Zap eine Wettbewerberseite, fragt Olostep AI Answer, um wichtige Updates von dieser Seite zusammenzufassen, und postet das endgültige Briefing mit Zitaten in Slack. Verwendete Knoten: Schedule by Zapier -> Olostep Scrape Website -> Olostep Ask AI Answer -> Slack

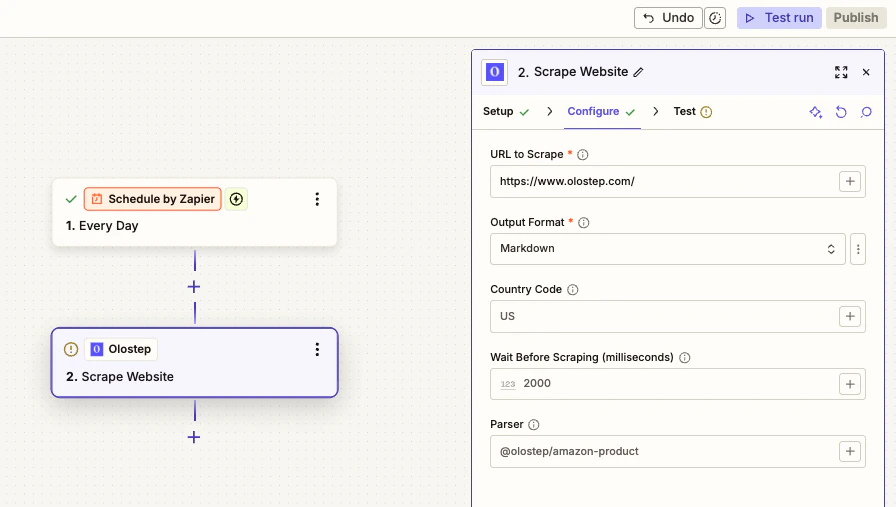

Schritt 1: Füge einen Schedule-Trigger hinzu

Erstelle in Zapier einen neuen Zap und setze den Trigger auf Schedule by Zapier. Stelle ihn so ein, dass er Jeden Tag zu einer für dein Team passenden Zeit (z. B. 8 Uhr) ausgeführt wird.Schritt 2: Füge Olostep Scrape Website hinzu

Füge eine Olostep-Aktion hinzu und wähle Scrape Website. Setze:- URL:

https://competitor.com/blog - Ausgabeformat: Markdown

Schritt 3: Füge Olostep Ask AI Answer hinzu

Füge eine zweite Olostep-Aktion hinzu und wähle Ask AI Answer. Setze:- Frage:

Was sind die wichtigsten Updates, Ankündigungen, Produktänderungen oder Preisänderungen auf dieser Seite heute? Gib ein prägnantes Briefing mit Aufzählungspunkten und Zitaten zurück. - Kontext-URLs (JSON-Array): Mappe die gescrapte URL aus Schritt 2

- Format: Markdown

- Zitate einfügen: true

Schritt 4: Sende an Slack

Füge eine Slack-Aktion hinzu, die auf Kanalnachricht senden gesetzt ist. Mappe:- Kanal:

#competitive-intel - Nachrichtentext:

Tägliches Wettbewerber-Briefing - Nachrichtentext:

{{Answer (Markdown)}}

Was du bekommst

Jeden Morgen erhält dein Slack-Kanal eine Nachricht wie:Tägliches Wettbewerber-BriefingVon hier aus kannst du diesen Zap erweitern: Füge einen Filter hinzu, um nur zu posten, wenn bestimmte Schlüsselwörter erscheinen, schreibe Briefings in Google Sheets zur Nachverfolgung oder führe separate Zaps für verschiedene Wettbewerber-URLs aus.Quellen: competitor.com/blog, competitor.com/pricing

- Neue Integration für E-Commerce-Workflows gestartet

- Preisseite mit einem neuen Mid-Tier-Plan aktualisiert

- Zwei neue Blogbeiträge über Automatisierungs-Best Practices veröffentlicht

Parser

Füge eine Parser-ID in das Parser-Feld bei jeder Scrape- oder Batch-Aktion ein, um strukturierte Daten anstelle von Rohinhalten zu erhalten:| Parser | Extrahiert |

|---|---|

@olostep/amazon-product | Titel, Preis, Bewertung, Rezensionen, Bilder, Varianten |

@olostep/google-search | Ergebnis-Titel, URLs, Snippets |

@olostep/google-maps | Geschäftsname, Adresse, Bewertung, Rezensionen |

@olostep/extract-emails | E-Mail-Adressen von jeder Seite |

@olostep/extract-socials | Links zu sozialen Profilen (X, GitHub, LinkedIn, etc.) |

@olostep/extract-calendars | Google Calendar- und ICS-Links |

Zapier-Einschränkungen & Workarounds

Aufgabenlimits

Zapier zählt jede Aktion als eine Aufgabe gegen das Limit deines Plans. Workaround: Verwende Batch Scrape URLs, um mehrere URLs als eine einzige Aufgabe zu verarbeiten, anstatt eine einzelne Scrape-Aktion zu schleifen.Ausführungszeitlimit

Zaps laufen nach 30 Sekunden ab. Crawls und große Batch-Jobs dauern länger. Workaround: Speichere die zurückgegebenecrawl_id oder batch_id und rufe die Ergebnisse in einem separaten Zap ab, der durch einen Webhook oder eine geplante Verzögerung ausgelöst wird.

Datenmengenbeschränkungen

Zapier begrenzt die Datenmenge, die zwischen Schritten übergeben werden kann, was bei großen Scrape-Datenmengen ein Problem sein kann. Workaround: Verwende gehostete Ausgabe-URLs, die von Olostep zurückgegeben werden, um große Inhalte separat abzurufen, anstatt Rohinhalte zwischen Schritten zu übergeben.Polling-Trigger

Die meisten Zapier-Trigger pollen in einem Intervall von 5–15 Minuten, nicht sofort. Workaround: Verwende den Webhooks-Trigger von Zapier für sofortige Benachrichtigungen oder plane Zaps zu festen Zeiten, anstatt sich auf nahezu Echtzeit-Polling zu verlassen.Fehlerbehebung

API-Schlüssel abgelehnt

API-Schlüssel abgelehnt

Kopiere den Schlüssel direkt von olostep.com/dashboard ohne nachfolgende Leerzeichen. Trenne und verbinde das Olostep-Konto in Zapier erneut, wenn der Fehler weiterhin besteht.

Gescrapte Inhalte sind leer

Gescrapte Inhalte sind leer

Erhöhe Warten vor Scraping (versuche 2000–5000ms für JS-lastige Seiten). Bestätige, dass die URL öffentlich zugänglich ist, ohne dass ein Login erforderlich ist. Wenn eine bestimmte Domain ständig fehlschlägt, kontaktiere info@olostep.com.

Batch-URL-Formatfehler

Batch-URL-Formatfehler

Das Feld URLs zum Scrapen erwartet ein JSON-Array:Verwende einen Code by Zapier-Schritt upstream, um dieses Array aus deinen Daten zu erstellen, falls erforderlich.

Ratenlimit erreicht

Ratenlimit erreicht

Füge einen Verzögerung-Schritt zwischen Scrape-Aktionen hinzu oder wechsle zu Batch Scrape URLs anstelle des Schleifens einzelner Scrapes. Überprüfe die aktuelle Nutzung im Dashboard.

Zap läuft bei Crawl oder Batch ab

Zap läuft bei Crawl oder Batch ab

Diese Operationen sind von Natur aus asynchron. Speichere die zurückgegebene ID sofort nach der Aktion und verwende dann einen zweiten Zap oder eine geplante Abfrage, um die Ergebnisse später abzurufen.

Verwandte Themen

Scrapes API

Vollständige Referenz für den Scrape-Endpunkt

Batches API

Wie Batch-Jobs funktionieren und wie man Ergebnisse abruft

Crawls API

Crawl-Konfiguration und Ergebnisabruf

Maps API

URL-Entdeckung und Filteroptionen

Zapier Website

Zapier-Plattform