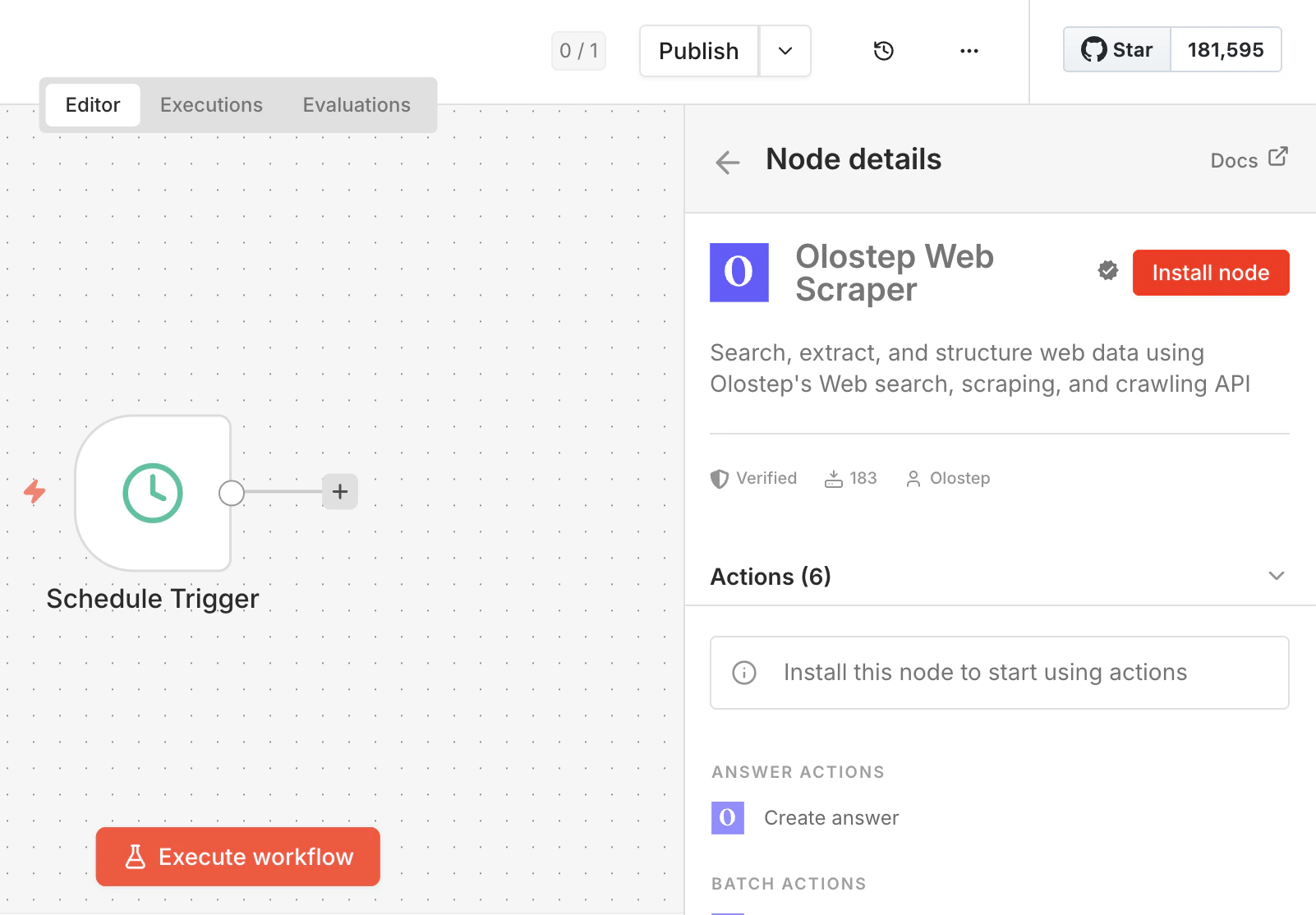

認証済みのOlostep Web Scraperノードは、n8nのビジュアルビルダー内で6つの操作を提供します:URLをスクレイプ、ウェブを検索、AI回答を取得、数千のURLをバッチスクレイプ、サイトをクロール、またはすべてのリンクをマップ。 n8nで見る →Documentation Index

Fetch the complete documentation index at: https://docs.olostep.com/llms.txt

Use this file to discover all available pages before exploring further.

始める前に

- APIキー付きのOlostepアカウント: 無料で取得、クレジットカードは不要です。最初の500クレジットが含まれています。

- n8nの実行: n8n Cloudまたはセルフホストされたインスタンス。コミュニティノードが有効である必要があります(ほとんどのセットアップではデフォルトで有効です)。

- コード不要: このガイドのすべてはn8nのビジュアルエディタを通じて行われます。

セットアップ

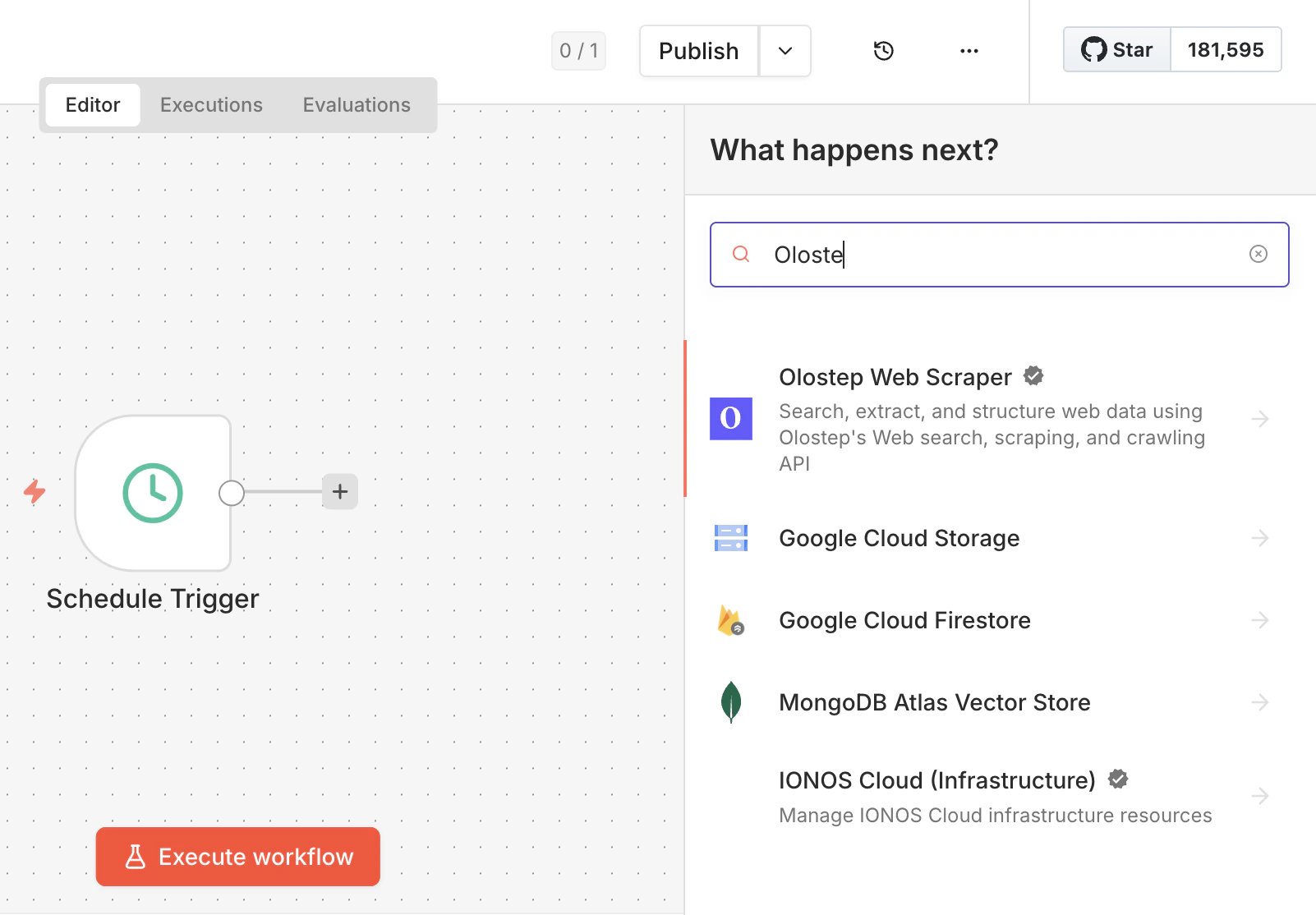

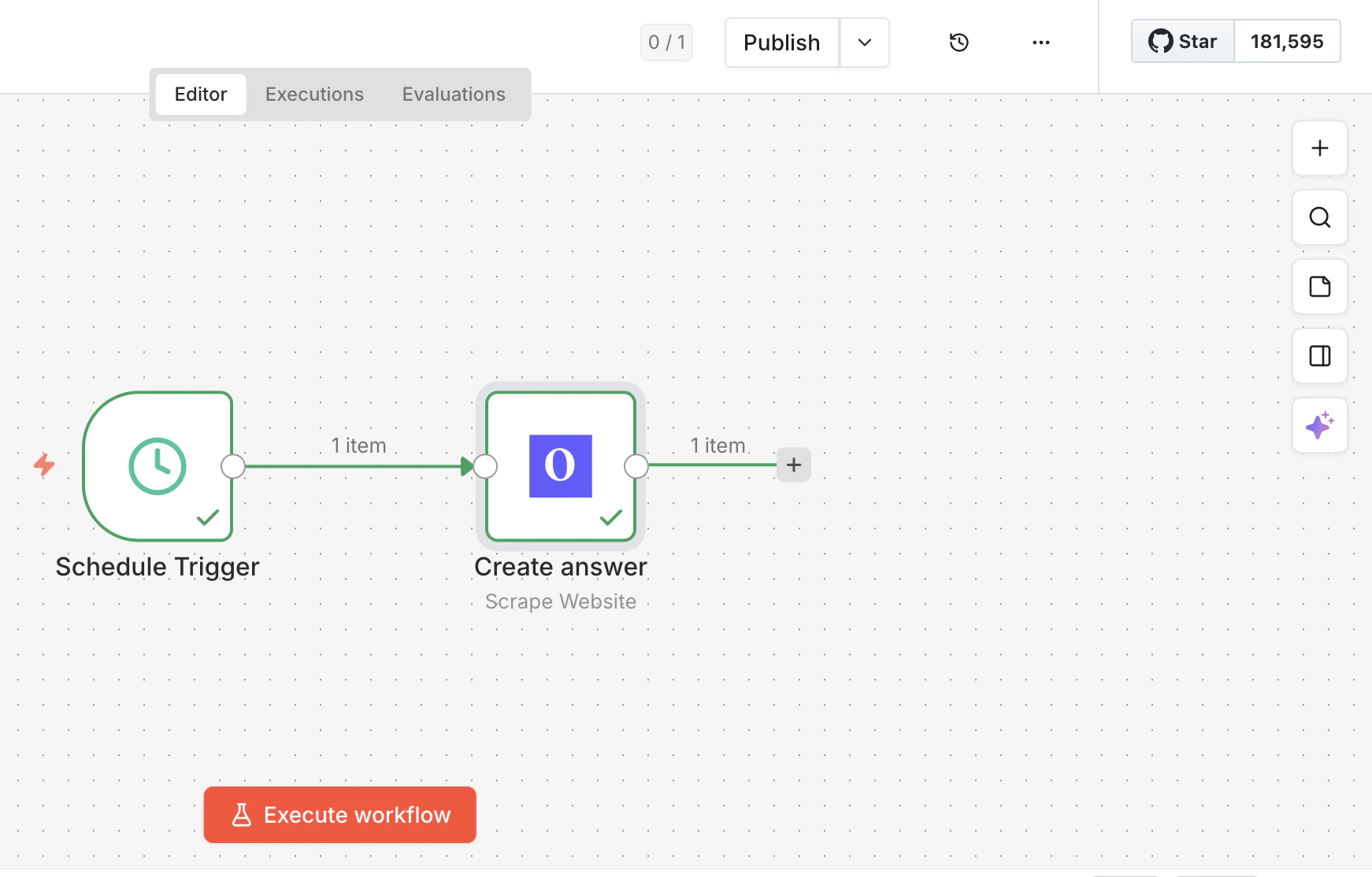

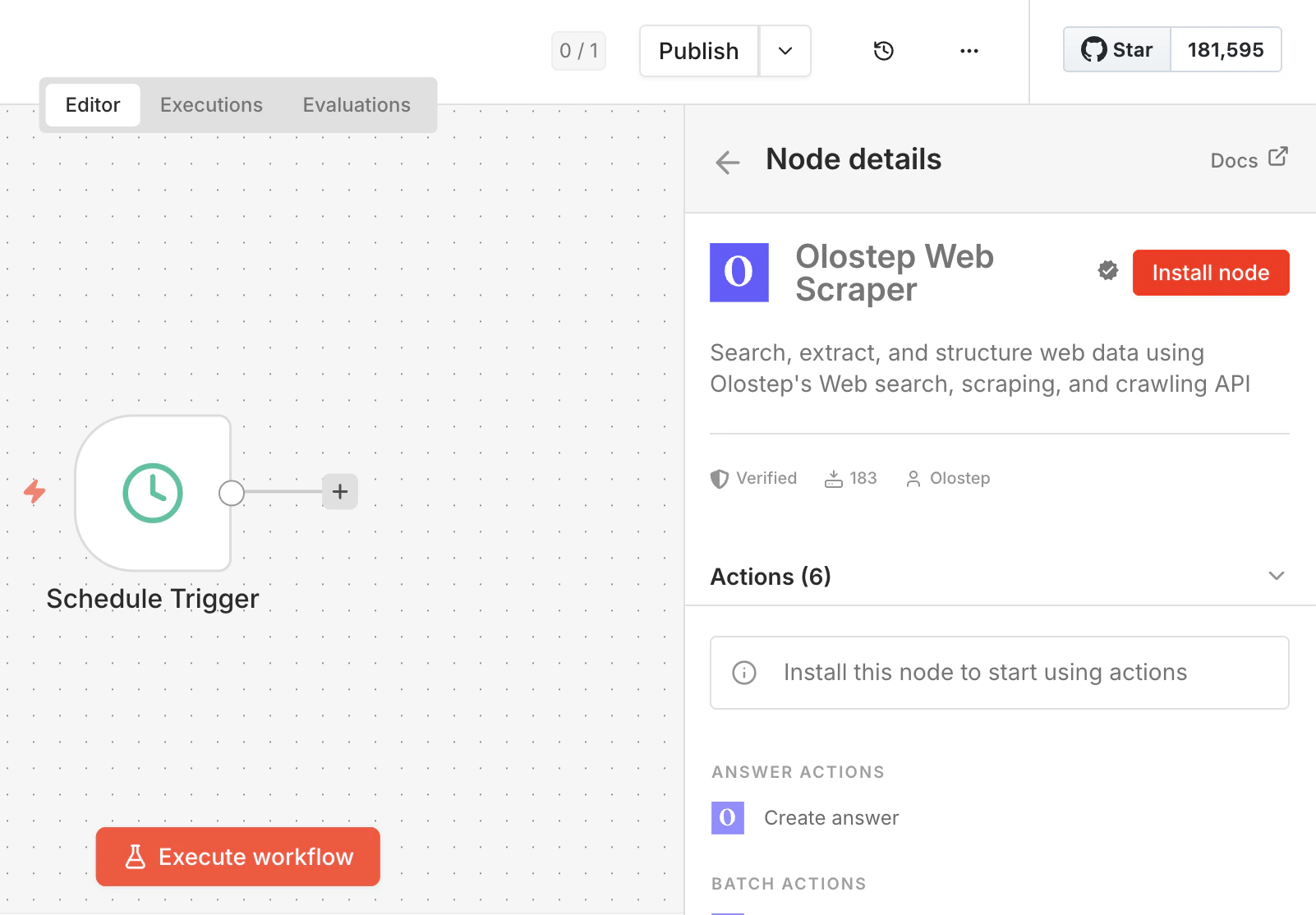

ノードをインストール

結果をクリックしてノード詳細パネルを開き、次にノードをインストールをクリックします。n8nは

n8n-nodes-olostepをインストールし、再起動を促します。続行する前にそれを行ってください。

ワークスペースでコミュニティノードが無効になっている場合、管理者が最初にそれを有効にする必要があります。n8nコミュニティノードガイドを参照してください。

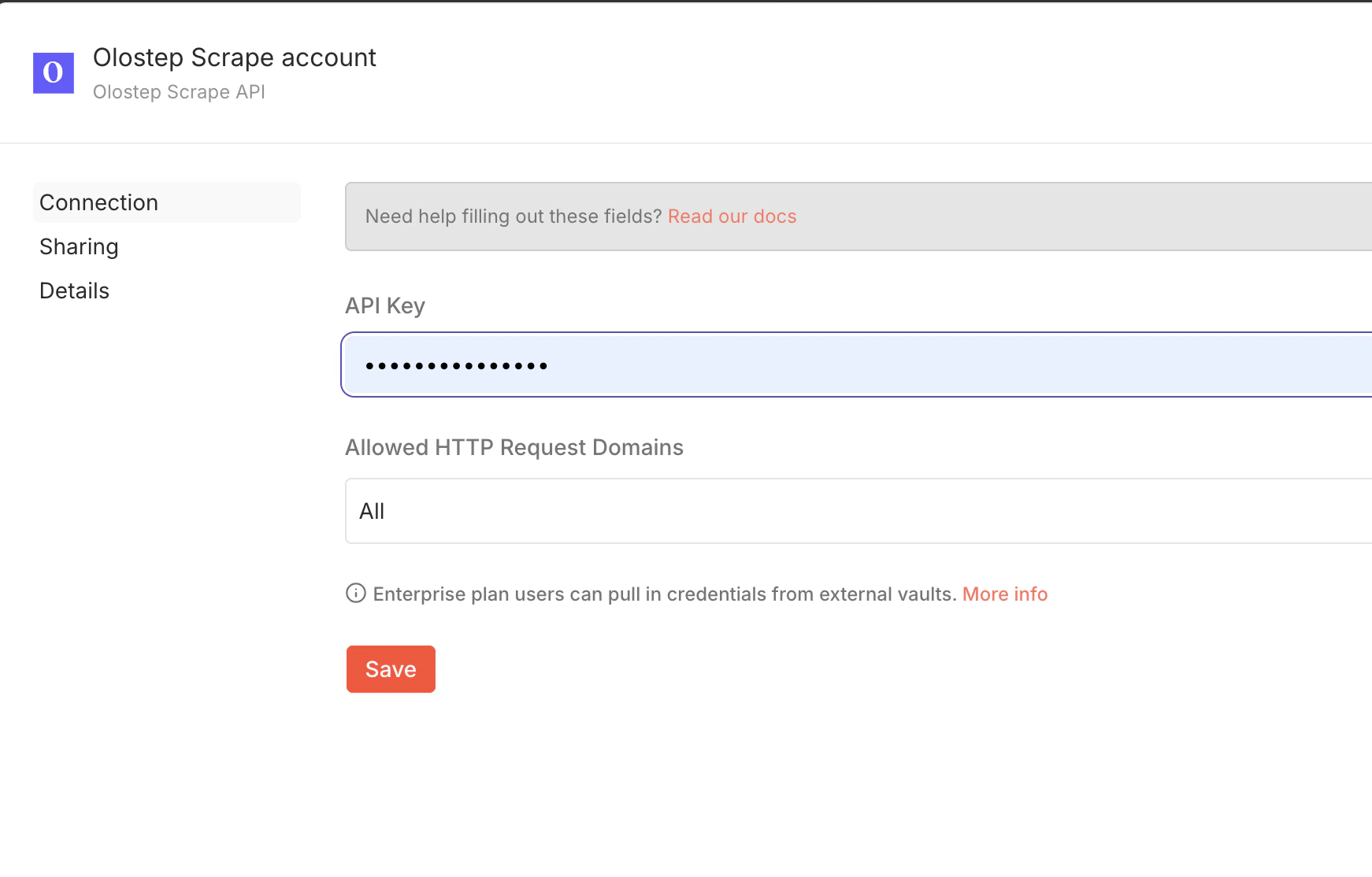

APIキーを追加

アクション

ウェブサイトをスクレイプ

任意のURLからMarkdown、HTML、JSON、またはプレーンテキストとしてコンテンツを取得します。オプションの待機時間と国ターゲティングでJSレンダリングされたページを処理します。

検索

ウェブ検索を実行し、構造化された結果(タイトル、URL、スニペット)をJSONとして取得します。

回答(AI)

自然言語の質問をして、引用元付きの回答を取得します。LLMノードの前に、根拠のある応答が必要な場合に便利です。

URLをバッチスクレイプ

1つのジョブで最大10,000のURLを提出し、並行して処理します。

batch_idを返し、結果を非同期で取得します。クロールを作成

URLから始めてリンクをたどり、すべてのサブページをスクレイプします。ドキュメントサイト、ブログ、またはサイト全体の取り込みに適しています。

crawl_idを返します。マップを作成

コンテンツをスクレイプせずにサイト上のすべてのURLを取得します。バッチジョブの前に発見に使用します。

map_idを返します。バッチ、クロール、マップは非同期です。 返されたIDを保存し、処理が完了したら結果を取得するためにWaitノードまたは2つ目のワークフローを使用します。

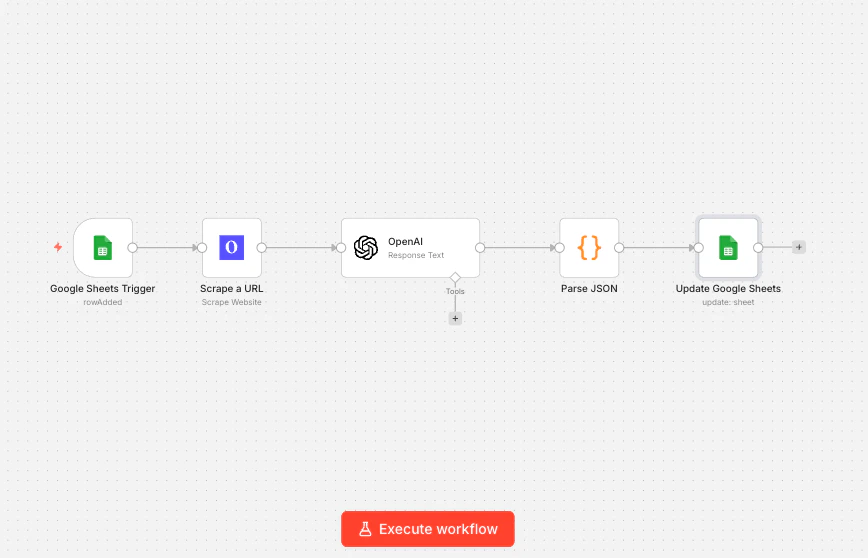

例のワークフロー:Google Sheetsからのリード強化

何をするか: Google Sheetに会社のURLを貼り付けると、このワークフローが自動的に会社のウェブサイトをスクレイプし、AIノードで主要情報を抽出し、結果を同じ行に書き戻し、空白のスプレッドシートを充実したリードデータベースに変えます。 使用ノード: Google Sheetsトリガー → Olostep Scrape Website → OpenAI → Code → Google Sheets更新

ステップ1:Google Sheetを設定

次の列を持つシートを作成します:Company URL、Industry、Description、Company Size、Enriched。ワークフローはCompany URLから読み取り、残りを埋めます。

ステップ2:Google Sheetsトリガーを追加

n8nで、Google Sheetsトリガーノードを追加します。イベントをRow Addedに設定し、シートを指定し、Company URL列を監視するように設定します。これで、新しいURLをシートに貼り付けるたびに、このワークフローが発火します。

ステップ3:Olostep Scrape Websiteを追加

トリガーの後にOlostep Web Scraperノードを接続します。設定:- アクション: ウェブサイトをスクレイプ

- URL:

{{ $json["Company URL"] }}(新しい行からURLを取得) - 出力形式: Markdown

ステップ4:OpenAIノードを追加

OpenAIノードを接続します。モデルをgpt-4o-miniに設定し(抽出タスクに速くて安価)、次のプロンプトを使用します:

markdownContentフィールドは、Olostepがスクレイプから返すクリーンなプレーンテキストです。

ステップ5:AIの応答を解析して書き戻す

Codeノードを追加して、OpenAIからのJSONを解析します:Industry→{{ $json.industry }}Description→{{ $json.description }}Company Size→{{ $json.company_size }}Enriched→Yes

得られるもの

https://notion.soのようなURLをシートに貼り付けると、約10秒以内に行が埋まります:

| Company URL | Industry | Description | Company Size | Enriched |

|---|---|---|---|---|

| https://notion.so | Productivity SaaS | All-in-one workspace for notes, docs, and databases | Mid-market | Yes |

テンプレート

Olostepで構築されたインポート可能なn8nワークフロー:ドキュメントをクロール → AIナレッジベース

Olostepでドキュメントサイトをクロールし、AI対応のナレッジベースに構造化します。

Google Mapsリード → 意思決定者の強化

Google Mapsからビジネスリードをスクレイプし、意思決定者の詳細で強化します。

ユーザーの苦情をマイニング → インサイトレポート

Olostep + Geminiで苦情を分析し、Google Docsで構造化されたインサイトレポートを生成します。

Amazon製品の抽出 → Google Sheets

OlostepでAmazon製品のURLとメタデータを抽出し、結果をSheetsに同期します。

パーサー

ParserフィールドにパーサーIDを追加して、スクレイプまたはバッチアクションで構造化データを取得します:| Parser | 抽出内容 |

|---|---|

@olostep/amazon-product | タイトル、価格、評価、レビュー、画像、バリエーション |

@olostep/google-search | 結果のタイトル、URL、スニペット |

@olostep/google-maps | ビジネス名、住所、評価、レビュー |

@olostep/extract-emails | 任意のページからのメールアドレス |

@olostep/extract-socials | ソーシャルプロファイルリンク(X、GitHub、LinkedInなど) |

@olostep/extract-calendars | Google CalendarとICSリンク |

トラブルシューティング

APIキーが拒否される

APIキーが拒否される

olostep.com/dashboardからキーを直接コピーし、末尾にスペースがないことを確認します。エラーが続く場合は、n8nでクレデンシャルを削除して再作成してください。

スクレイプされたコンテンツが空

スクレイプされたコンテンツが空

スクレイプ前の待機を増やします(JSが多いページには2000–5000msを試してください)。URLがログインなしで公開アクセス可能であることを確認します。特定のドメインが一貫して失敗する場合は、info@olostep.comに連絡してください。

バッチURL形式エラー

バッチURL形式エラー

スクレイプするURLフィールドはJSON配列を期待しています:必要に応じて、上流でCodeノードを使用してこの配列をデータから構築します。

レート制限に達した

レート制限に達した

スクレイプステップ間にWaitノードを追加するか、単一スクレイプをループする代わりにBatch Scrape URLsに切り替えます。ダッシュボードで現在の使用状況を確認してください。

設定でコミュニティノードが表示されない

設定でコミュニティノードが表示されない

n8n Cloudでは、コミュニティノードはワークスペースオーナーによって有効にされる必要があります。セルフホストでは、

N8N_COMMUNITY_PACKAGES_ENABLED=trueが環境に設定されていることを確認します。n8nのインストールガイドを参照してください。関連

Scrapes API

スクレイプエンドポイントの完全なリファレンス

Batches API

バッチジョブの仕組みと結果の取得方法

Crawls API

クロールの設定と結果の取得

Maps API

URLの発見とフィルタリングオプション

始めましょう

ウェブ検索、スクレイピング、クロールワークフローを自動化する準備はできましたか?n8nウェブサイト

n8nプラットフォーム

ノードをインストール

n8n-nodes-olostepをインストールして、自動化ワークフローの構築を開始