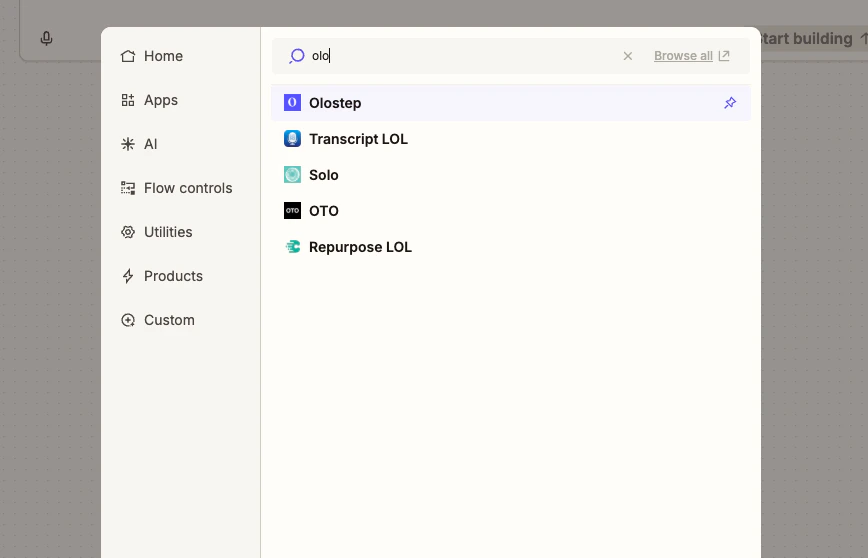

ZapierのOlostepアプリは、Zapierのビジュアルビルダー内で5つのアクションを提供します: URLをスクレイピングする、AIの回答を得る、数千のURLをバッチスクレイピングする、サイトをクロールする、またはすべてのリンクをマッピングし、その結果を8,000以上のアプリに接続します。 Zapierで見る →Documentation Index

Fetch the complete documentation index at: https://docs.olostep.com/llms.txt

Use this file to discover all available pages before exploring further.

始める前に

- APIキー付きのOlostepアカウント: 無料で取得できます。クレジットカードは不要です。最初の500クレジットが含まれています。

- Zapierアカウント: どのプランでも利用可能です。無料プランではZapを手動で実行でき、有料プランではスケジュールとマルチステップZapをサポートします。

- コード不要: このガイドのすべてはZapierのビジュアルエディタを通じて行われます。

セットアップ

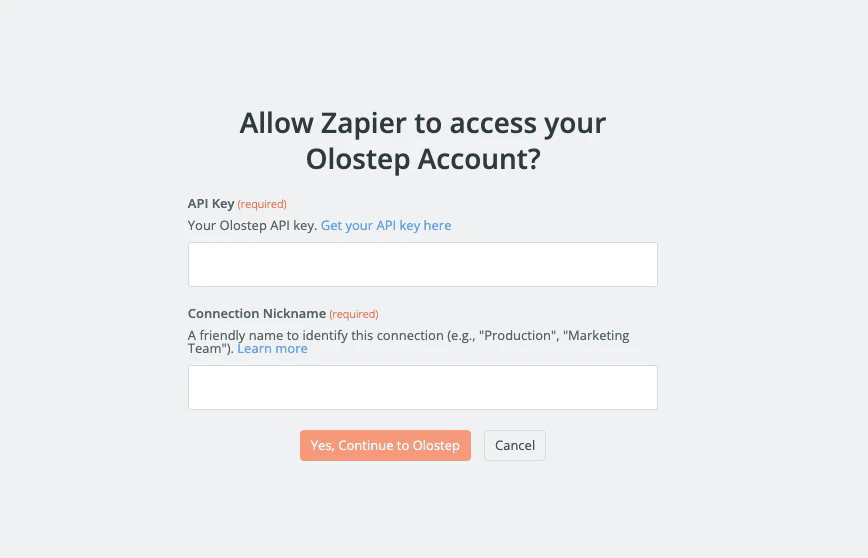

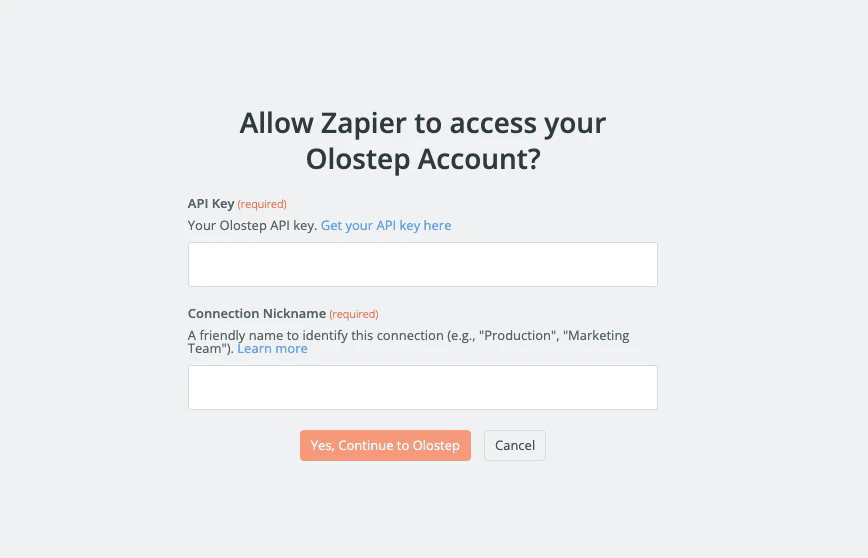

アカウントを接続する

Sign in to Olostepをクリックします。APIキーをフィールドに貼り付け、Yes, Continue to Olostepをクリックします。Zapierはキーを確認し、今後のすべてのZapに対して資格情報を保存します。

ウェブサイトをスクレイピングする (URL + フォーマット)

- スクレイピングするURL: トリガーからマッピングするか手動で入力

-

出力フォーマット:

Markdown、HTML、JSON、またはTextを選択

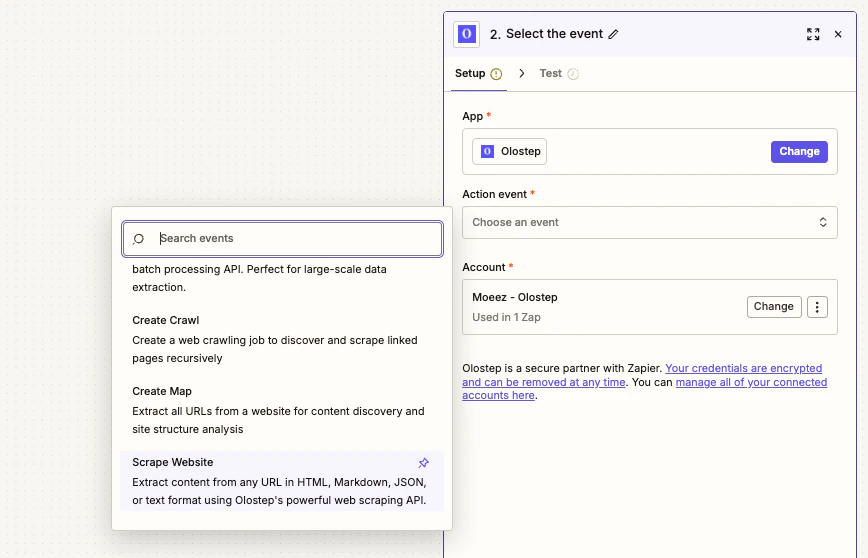

アクション

ウェブサイトをスクレイピング

任意のURLからMarkdown、HTML、JSON、またはプレーンテキストとしてコンテンツを取得します。オプションの待機時間と国別ターゲティングでJSレンダリングされたページを処理します。

AIに質問

自然言語の質問をして、提供したページやライブウェブ検索に基づいた引用付きの回答を得ます。

URLをバッチスクレイピング

1つのジョブで最大100,000のURLを提出し、並行して処理します。

batch_idを返し、結果を非同期で取得します。クロールを作成

URLから始めてリンクをたどり、すべてのサブページをスクレイピングします。ドキュメントサイト、ブログ、またはサイト全体の取り込みに適しています。

crawl_idを返します。マップを作成

コンテンツをスクレイピングせずにサイト上のすべてのURLを取得します。バッチジョブの前に発見に使用します。

map_idを返します。バッチ、クロール、マップは非同期です。 返されたIDを保存し、処理が完了したら結果を取得するためにDelayステップまたは2つ目のZapを使用してください。

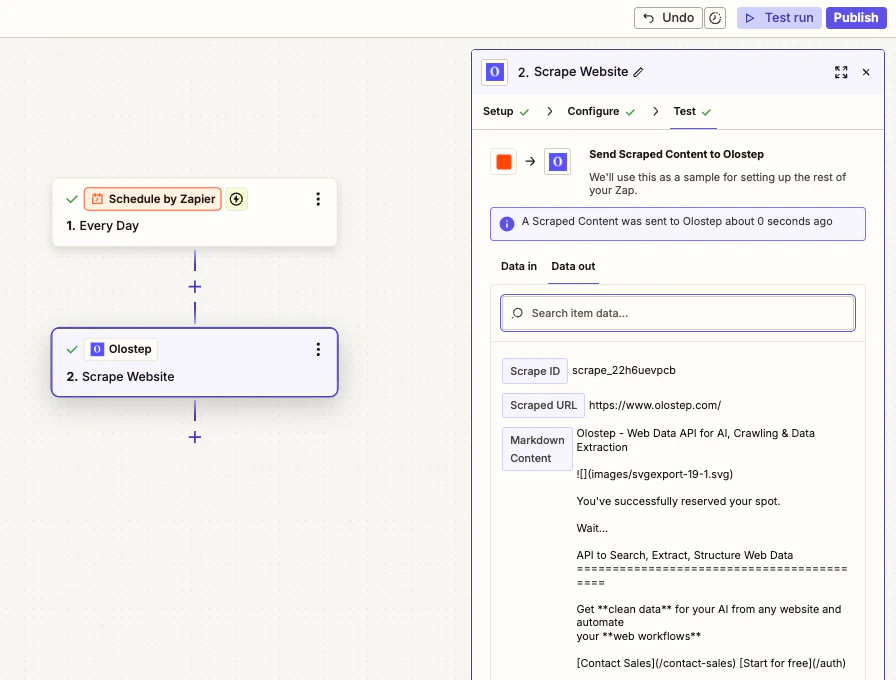

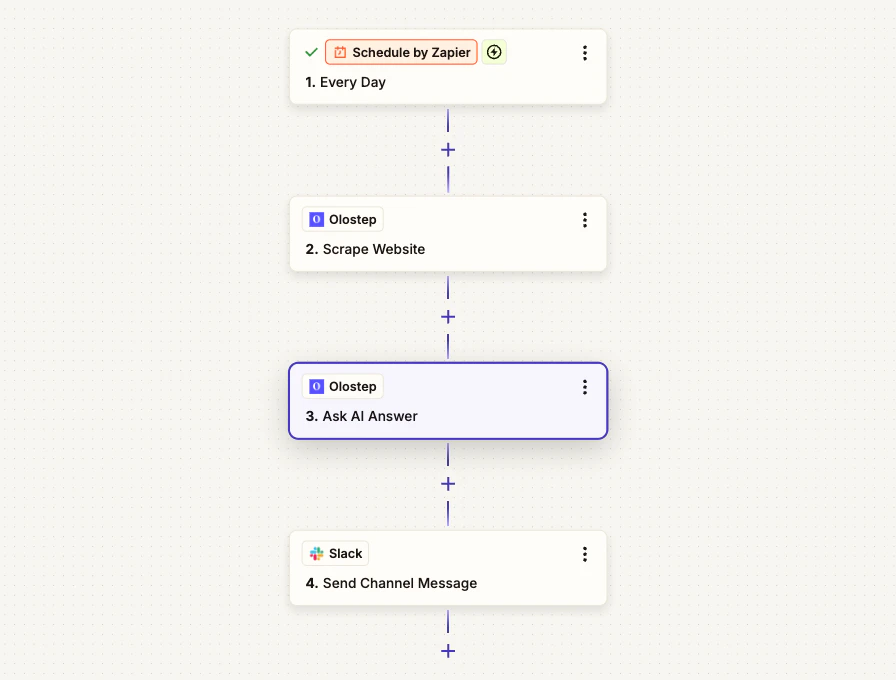

例のワークフロー: 毎日の競合他社ブリーフィング

何をするか: 毎朝、このZapは競合他社のページをスクレイピングし、Olostep AI Answerにそのページからの重要な更新を要約させ、最終的なブリーフィングを引用付きでSlackに投稿します。 使用するノード: Schedule by Zapier -> Olostep Scrape Website -> Olostep Ask AI Answer -> Slack

ステップ1: スケジュールトリガーを追加

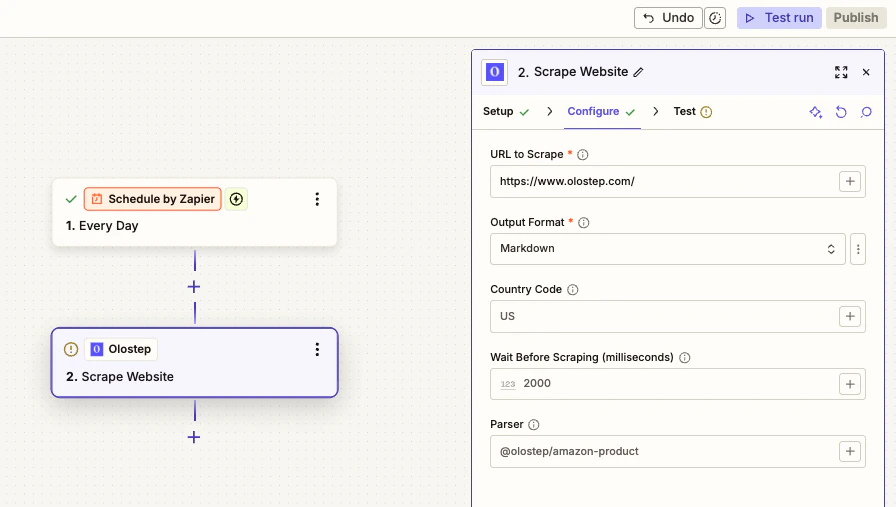

Zapierで新しいZapを作成し、トリガーをSchedule by Zapierに設定します。チームに合った時間(例: 午前8時)にEvery Dayで実行するように設定します。ステップ2: Olostep Scrape Websiteを追加

Olostepアクションを追加し、Scrape Websiteを選択します。設定:- URL:

https://competitor.com/blog - 出力フォーマット: Markdown

ステップ3: Olostep Ask AI Answerを追加

2つ目のOlostepアクションを追加し、Ask AI Answerを選択します。設定:- 質問:

今日このページでの主要な更新、発表、製品変更、または価格変更は何ですか? 箇条書きで簡潔なブリーフィングを返し、引用を含めてください。 - コンテキストURL (JSON配列): ステップ2からのスクレイピングされたURLをマッピング

- フォーマット: Markdown

- 引用を含める: true

ステップ4: Slackに送信

Slackアクションを追加し、Send Channel Messageに設定します。マッピング:- チャンネル:

#competitive-intel - メッセージテキスト:

Daily Competitor Briefing - メッセージ本文:

{{Answer (Markdown)}}

得られるもの

毎朝、Slackチャンネルに次のようなメッセージが届きます:Daily Competitor BriefingここからこのZapを拡張できます: 特定のキーワードが出現した場合のみ投稿するようにフィルターを追加したり、追跡用にGoogle Sheetsにブリーフィングを書き込んだり、異なる競合他社のURL用に別のZapを実行したりできます。ソース: competitor.com/blog, competitor.com/pricing

- 新しいeコマースワークフロー用の統合を開始

- 新しいミッドティアプランで価格ページを更新

- 自動化のベストプラクティスに関する2つの新しいブログ投稿を公開

パーサー

任意のスクレイプまたはバッチアクションのParserフィールドにパーサーIDを追加して、生のコンテンツの代わりに構造化データを取得します:| パーサー | 抽出内容 |

|---|---|

@olostep/amazon-product | タイトル、価格、評価、レビュー、画像、バリエーション |

@olostep/google-search | 結果のタイトル、URL、スニペット |

@olostep/google-maps | ビジネス名、住所、評価、レビュー |

@olostep/extract-emails | 任意のページからのメールアドレス |

@olostep/extract-socials | ソーシャルプロファイルリンク (X, GitHub, LinkedInなど) |

@olostep/extract-calendars | Google CalendarとICSリンク |

Zapierの制限と回避策

タスク制限

Zapierは各アクションをプランの制限に対する1つのタスクとしてカウントします。 回避策: Batch Scrape URLsを使用して、単一のスクレイプアクションをループする代わりに複数のURLを単一のタスクとして処理します。実行タイムアウト

Zapは30秒後にタイムアウトします。クロールや大規模なバッチジョブはそれ以上の時間がかかります。 回避策: 返されたcrawl_idまたはbatch_idを保存し、Webhookまたはスケジュールされた遅延でトリガーされる別のZapで結果を取得します。

データサイズ制限

Zapierはステップ間で渡すことができるデータサイズを制限しており、大規模なスクレイプペイロードでは問題になることがあります。 回避策: Olostepが返すホストされた出力URLを使用して、大規模なコンテンツを別途取得し、生のコンテンツをステップ間で渡すのではなくします。ポーリングトリガー

ほとんどのZapierトリガーは5〜15分間隔でポーリングし、即時ではありません。 回避策: ZapierのWebhooksトリガーを使用して即時通知を受け取るか、ほぼリアルタイムのポーリングに頼るのではなく、固定時間にZapをスケジュールします。トラブルシューティング

APIキーが拒否されました

APIキーが拒否されました

olostep.com/dashboardから直接キーをコピーし、末尾にスペースがないことを確認します。エラーが続く場合は、ZapierでOlostepアカウントを切断して再接続してください。

スクレイピングされたコンテンツが空です

スクレイピングされたコンテンツが空です

Wait Before Scrapingを増やします(JSが多いページには2000〜5000msを試してください)。URLがログインなしで公開アクセス可能であることを確認します。特定のドメインが一貫して失敗する場合は、info@olostep.comに連絡してください。

バッチURL形式エラー

バッチURL形式エラー

スクレイピングするURLフィールドはJSON配列を期待します:必要に応じて、データからこの配列を構築するために上流でCode by Zapierステップを使用します。

レート制限に達しました

レート制限に達しました

スクレイプアクション間にDelayステップを追加するか、単一のスクレイプをループする代わりにBatch Scrape URLsに切り替えます。現在の使用状況はダッシュボードで確認できます。

Zapがクロールまたはバッチでタイムアウトします

Zapがクロールまたはバッチでタイムアウトします

これらの操作は設計上非同期です。アクション直後に返されたIDを保存し、後で結果を取得するために2つ目のZapまたはスケジュールされたポーリングを使用します。

関連

Scrapes API

スクレイプエンドポイントの完全なリファレンス

Batches API

バッチジョブの動作と結果の取得方法

Crawls API

クロールの設定と結果の取得

Maps API

URLの発見とフィルタリングオプション

Zapier Website

Zapierプラットフォーム